其实很简单。。。没一点技术含量,就是小白(包括我)纯啥都不知道而已。于是这里把流程分享出来方便各位操作。

在你提出疑问之前,你应当至少阅读并理解此内容:提问的智慧

# 配置要求

- 需要 64 位处理器和操作系统

- 显卡: GeForce RTX 2060 SUPER or Radeon RX 5700 XT or Arc A770

- 内存: 16 GB RAM

- 存储空间: 需要 10GB 可用空间

特别提示:如你的设备没有显示卡,那么本地运行大模型将极为吃力

# ollama是什么

Ollama 是一个开源的、极简的本地大模型运行平台。你可以把它理解成一个专门为AI大模型设计的“应用商店”+“运行环境”,让你能在自己的电脑上轻松下载、运行和管理各种开源大模型(如 Llama、DeepSeek、Qwen 等),整个过程就像安装普通软件一样简单,且数据完全留在本地

# 安装ollama

下载ollama至本地,网址如下

下载好后先别急着安装

(可选)改变ollama及模型默认安装地址

ollama的下载地址默认是c盘,我们可以把他装载到其他分区中

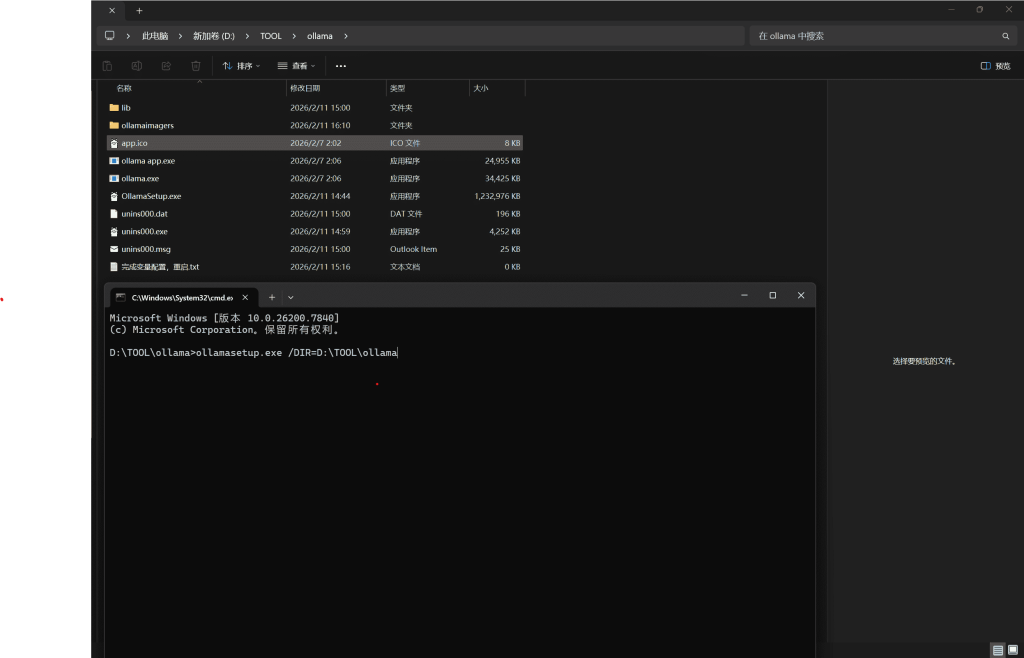

点击目标目录上方地址栏,输入cmd,回车,呼出命令提示符

输入代码:ollamasetup.exe /DIR=文件夹路径 文件夹路径即目标目录 ,注意安装路径不应该出现中文

比如说我就选择安装到D盘的\TOOL\ollama目录下

ollama安装完成后,你可以在ollama app中进入settings修改模型安装位置

# 下载模型

进入ollama网站,点击左上角models

如果你不知道如何挑选大模型,你应当查找相关资料。本文档不提供模型推荐。

我这里选用了translategemma:4b大模型

复制代码 ollama run translategemma:4b

win+R呼出运行框,输入cmd打开命令提示符,粘贴以上代码进行模型下载

下载完毕后即可对此模型进行调用,如你希望自由使用模型,你应当查找相关指令

# 接入LiveCaptions-Translator

转到:https://github.com/SakiRinn/LiveCaptions-Translator

点击右侧栏 releases进入下载页

选择x64程序,下载

完毕后运行打开设置界面

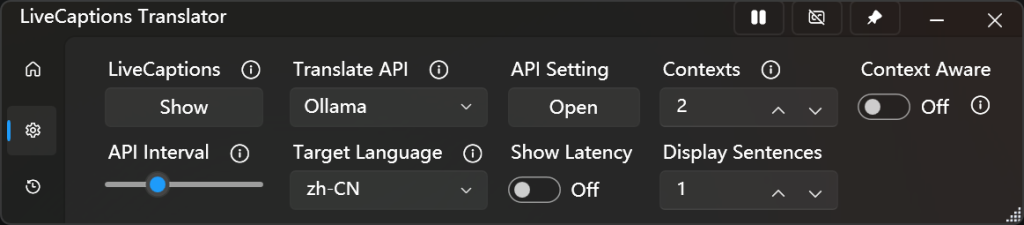

将Translate API改为ollama

进入API Setting界面,找到Ollama设置,将Model Name改为translategemma:4b或你选择的模型名,完成配置

如你希望找到对应模型名,可以打开命令提示符输入: ollama list

教程到此结束,如仍有疑问可以移步评论区

Comments 1 条评论

如果你需要GitHub加速器,我推荐Watt Toolkit(原steam++)